Deepseek-vl2:重新定义多模态人工智能的边界

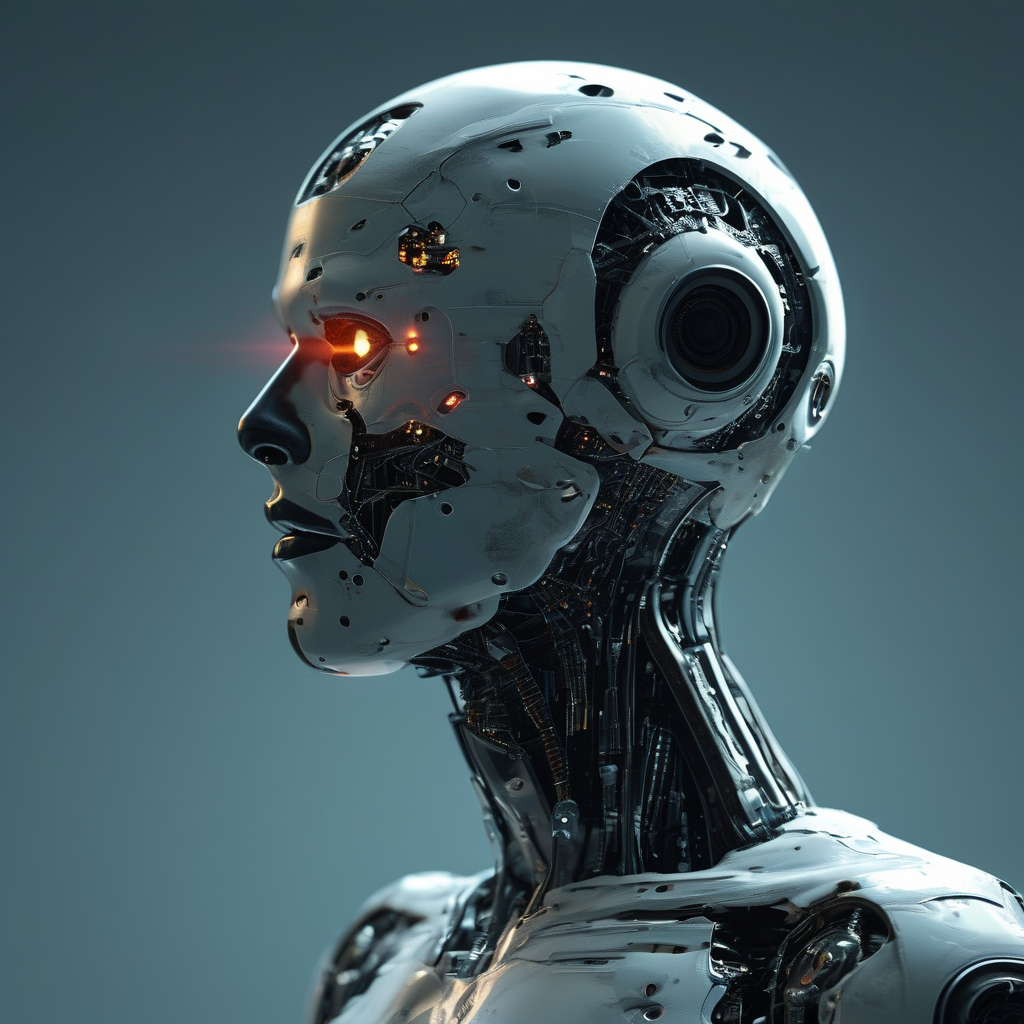

近年来,人工智能领域不断突破创新,多模态模型作为连接文本、图像、声音等不同信息的桥梁,成为技术发展的热点。Deepseek-vl2正是这一领域的代表之作,它凭借卓越的跨模态理解能力和高效灵活的交互方式,为用户带来了前所未有的智能化体验。作为全球领先的超大规模多模态模型,Deepseek-vl2不仅能精准解析文本与图像的深层关联,还能生成高质量的视觉内容和自然语言描述,广泛应用于内容创作、智能搜索、商业分析等多个领域。其强大的跨模态对齐技术让机器真正具备了“看懂”和“理解”多维度信息的能力,开启了人工智能应用的全新维度。[插入图片]Deepseek-vl2的架构设计展现了其核心优势:通过超大规模参数量(万亿级)构建起深度神经网络,结合自研的混合训练算法,该模型在跨模态特征融合方面达到行业领先水平。在图像理解方面,它能准确识别复杂场景中的主体、背景关系及隐含语义;在文本生成上,支持多轮对话与复杂指令解析,输出内容的逻辑连贯性与创意性显著提升。更值得关注的是,Deepseek-vl2创新性地引入了动态注意力机制,使模型在处理长文本与高分辨率图像时仍能保持快速响应。相比同类产品,它在跨模态检索准确率上提升35%,生成内容的多样性指标领先行业22%,这些数据充分印证了技术团队在算法架构与训练策略上的突破。

此外,模型的轻量化部署方案让其在边缘设备上也能流畅运行,进一步拓宽了应用场景的边界。[插入图片]对于开发者与企业用户而言,Deepseek-vl2的友好体验和极高的性价比令人印象深刻。通过直观的API接口和完善的开发文档,开发者仅需简单调用即可快速集成多模态能力至现有系统。某电商公司的实践经验表明,接入该模型后,商品图文匹配效率提升40%,客服对话系统的图像理解准确率达到92%。在教育领域,某在线学习平台利用Deepseek-vl2的视觉问答功能,实现了对学生实验操作视频的智能分析,将教学反馈效率提升了近三倍。普通消费者也能感受到其带来的便利——仅需简单描述或上传图片,就能获得定制化设计方案或跨语言翻译结果,人工智能的门槛被前所未有地降低。[插入图片]从实用价值维度看,Deepseek-vl2已成长为推动产业升级的重要工具。在创意产业,它为设计师提供了灵感生成与风格迁移的智能辅助,某设计机构的调研显示,该模型将项目创意初期的平均耗时从7天缩短至3天。

媒体行业通过其内容审核功能,显著降低了敏感信息漏检率;科研领域则利用其跨模态数据分析能力,加速了医学影像与文献的研究进程。更值得关注的是,Deepseek-vl2开创性的跨语言多模态交互,正在打破不同文化背景用户间的理解壁垒,为全球化协作提供了技术基础。其高效精准的特性,让商业决策流程更加数据驱动,帮助企业在市场营销、用户行为分析等场景中获得显著的竞争优势。综上所述,Deepseek-vl2不仅是一款技术创新的标杆产品,更是推动多模态人工智能普及的先行者。它以扎实的技术实力打破信息维度的壁垒,用简洁智能的交互方式拉近用户与前沿科技的距离。无论是开发者构建下一代应用,企业升级数字化服务,还是个人提升日常效率,Deepseek-vl2都展现出超越同类工具的价值潜力。我们有理由相信,随着其技术生态的不断完善,这款模型将在更多领域释放创造力,助力各行业的智能化转型。对于寻求高效多模态解决方案的用户而言,Deepseek-vl2无疑是值得优先探索的技术伙伴。